Macchine che fingono di essere intelligenti

di Stefano Penge

In questi ultimi anni si sta diffondendo un approccio che epistemologicamente e eticamente sembra mettere in discussione tutto quello che abbiamo saputo o creduto di sapere. Un passaggio che vale la pena di evidenziare e di discutere, anche e soprattutto in ambito educativo.

Fino a poco fa, i computer erano al nostro fianco nell’esplorazione dell’universo, più precisi di noi, instancabili, più determinati nel non commettere errori e non trarre conclusioni avventate. Gli affidavamo il calcolo delle traiettorie degli aerei, sulla base della matematica e della fisica che avevamo verificato nel corso due millenni precedenti, perché eravamo certi che avrebbero fatto meno pasticci di noi. Li immaginavamo come servi affidabili e incorruttibili. Un po’ come il primo Terminator impersonato da Arnold Schwartzenegger: magari brutale, ma efficace e soprattutto fedele.

VAI ALLA RUBRICA SULLA INTELLIGENZA ARTIFICIALE

Invece è arrivata un’altra generazione di Terminator, più sottile, elegante, fluida. Il modello di software intelligente che va di moda oggi è bravo a fare molte cose, ma soprattutto una in particolare: fingere, cioè cambiare aspetto e assumere quello di chiunque altro. Non sa risolvere un problema o creare un minuetto partendo dalla regole della musica occidentale settecentesca, però può produrre degli artefatti che non sembrano artificiali, che assomigliano a qualcosa che avrebbe potuto produrre un essere umano. Di fatto, assomigliano a molte cose che esseri umani hanno prodotto, contemporaneamente.

Questa capacità, dal punto di vista della storia dei media, non è eccezionale ma è proprio tipica dei computer. E’ un caso limite di re-mediation, cioè della tendenza dei media digitali di copiare i corrispondenti analogici, di inglobarli, di sostituirli. Ne ho parlato e scritto più volte perché è una capacità da cui sono sempre stato affascinato; due esempi qui [https://www.stefanopenge.it/wp/strumenti-digitali-usati-analogicamente/] e qui [https://www.stefanopenge.it/wp/digitale-unetimologia-istruttiva/].

L’impatto è indubitabilmente straordinario e ha fatto intravvedere l’avvento della “singolarità”, cioè del primo computer veramente intelligente e consapevole; tanto che mentre alcuni salutano l’alba di una nuova era transumanista in altri ambienti si sono scatenate le paure dell’intelligenza artificiale senza coscienza etica che presto dominerà il mondo (come Skynet nella saga di Terminator).

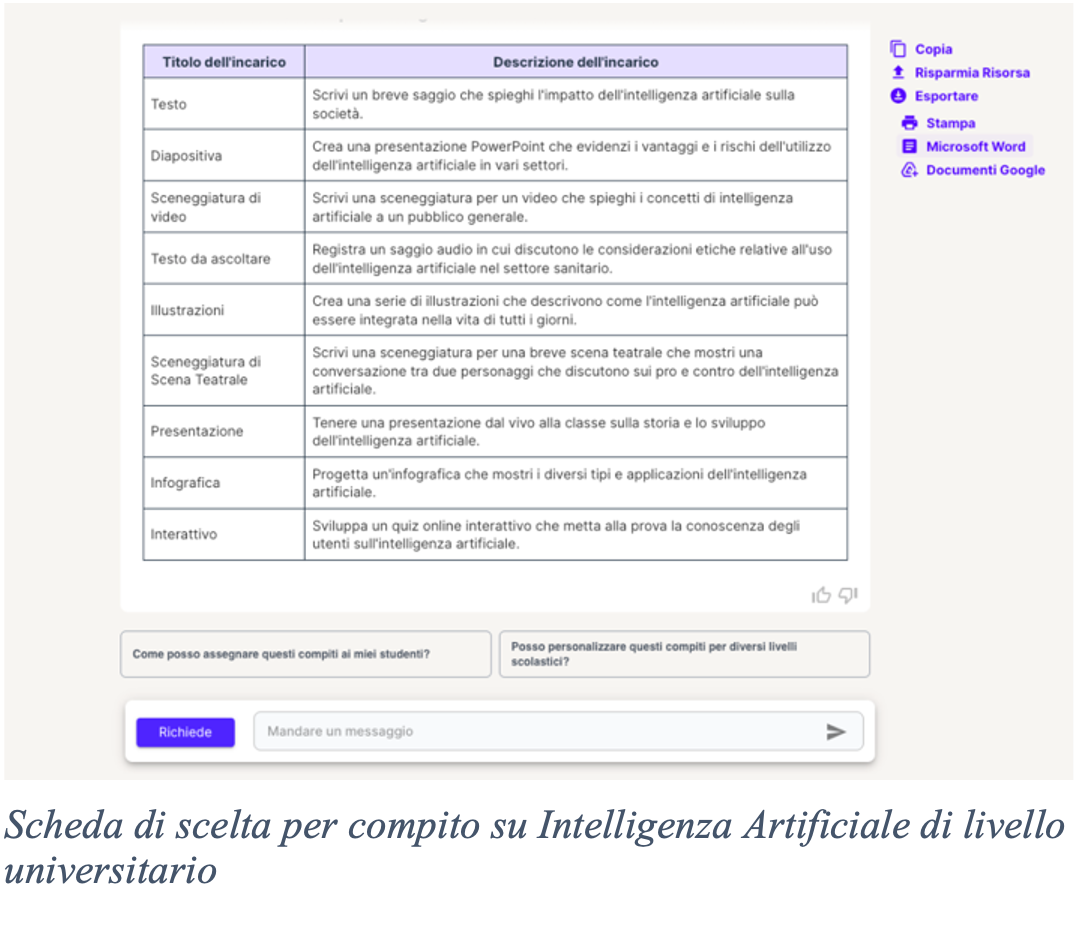

Mentre alcuni si sono affrettati a descrivere i mutamenti nella pratica lavorativa quotidiana (almeno in certi settori: la pubblicità, la comunicazione) e a cercare di sfruttarli professionalmente in termini di consulenza e formazione, tanti docenti di buona volontà si sono impegnati a imparare a usare il “prompt”, anche senza sapere bene come funziona, e si sono sforzati di capire come sfruttarlo a fini educativi; con attenzione, certo, perché altrimenti gli studenti ci mettono un attimo a farsi scrivere il riassunto del terzo canto dell’Inferno.

In generale, come per tutti i servizi digitali a cui siamo abituati, questi docenti lo usano senza fare troppo caso al fatto che il loro uso è libero e gratuito. La messa a disposizione gratuita di uno strumento che ha avuto dei costi di sviluppo e di gestione stratosferici è, a mio parere, un indicatore di un progetto di marketing più complesso, che inizia con il beta test su scala mondiale e poi passa per la commercializzazione di servizi personalizzati alle pubbliche amministrazioni, alle aziende, ai professionisti e, perché no?, alle scuole.

Parliamo allora del magico “prompt”, che è il termine che si usa oggi per indicare le richieste (o ricette?) che si inviano ad un servizio online come ChatGPT per ottenere un testo (o un’immagine, o un’animazione, un audio, un video). Infatti il termine collettivo per tutti questi servizi è “intelligenza artificiale generativa”.

Oggi prompt è diventato un termine di moda, una buzz word. E’ la porta d’ingresso per l’oracolo, come direbbe Gino Roncaglia.[i] Tra parentesi, è curioso che dopo anni in cui la maniera di interagire con un computer usando la tastiera (anziché il mouse o il touchpad o le dita libere nello spazio virtuale) veniva considerata superata oggi è diventata una modalità avanzatissima, quasi da hacker da salotto. Nemmeno i fieri possessori di Mac si sono lamentati. Anzi è possibile che gli effetti completi in termini di mode culturali ancora siano da vedere. Nella prossima pubblicità di Nespresso si vedrà George Clooney premere tasti per farsi fare il suo caffè preferito.

Ma che significa prompt? Come spesso succede, c’è stato uno slittamento dalla forma alla materia, dallo strumento al contenuto. E’ successo per “Social Network System”, che sarebbero i software che gestiscono le reti sociali ma che sono diventati “i social”, cioè i gruppi di persone con cui abbiamo a che fare. E’ successo per “cloud”, che è il modo di dividere i software su più hardware virtualizzati, ma che è diventato il luogo unico di ogni documento che non sta sul nostro PC. Tutti questi spostamenti di senso vanno nella direzione della semplificazione, cioè della messa tra parentesi della complessità tecnica, ma anche di quella organizzativa e lavorativa. Appena i “social” divengano oggetti dotati di natura propria ci si dimentica che sono costruiti con dei filtri applicati sulla base della profilazione degli utenti, a sua volta costruita leggendo e analizzando messaggi e azioni. Appena il “cloud” diventa un sinonimo di “remoto, lontano, chissà dove” ci si dimentica che la proprietà di quel nostro documento una volta messo nella nuvola è dubbia e così sono vaghi i confini dei suoi usi possibili da parte da qualcuno che non siamo noi.

Torniamo a prompt. In inglese significa letteralmente “pronto” ed era il simbolo che appariva, e appare ancora, nelle finestre di interazione testuale con i sistemi operativi dei computer. Per esempio, in Linux può essere qualcosa di questo tipo:

[stefano@fedora -]$ □

mentre nei vecchi computer con il sistema MSDOS appariva così:

C:\>_

In genere l’ultimo carattere lampeggia, a significare che il software è in esecuzione, non si è bloccato, ma sta aspettando un comando. E’ pronto. A quel punto si possono scrivere comandi semplici oppure richiamare interi programmi passando dei valori come parametri. Ad esempio, in Linux il comando ls mostra l’elenco dei file e delle directory (come era in DOS il comando DIR); ma:

ls -d */ | grep ‘Doc*’

fa qualcosa di più: mostra solo le cartelle il cui nome inizia per ‘Doc’. Si possono anche fare anche operazioni sofisticate che agiscono su blocchi di informazioni strutturate, come questa:

sed -e ‘s/occhi/orecchi/g’ -e ‘s/vidi/sentii/g’ inferno.txt

che sostituisce tutte le occorrenze della parola ‘occhi’ con ‘orecchi’ e ‘vidi’ con ‘sentii’ in un file di testo che presumibilmente contiene l’inferno di Dante.

Da questo punto di vista, i prompt attuali sono un po’ la stessa cosa: invocazioni di programmi (che però non conosciamo esattamente) a cui si passano come parametri una serie di valori. Ad esempio, in questo prompt:

I would like to learn about quantum mechanics. Please provide me with a brief summary of spin that could be understood by a 10-year-old.

ci sono tre parametri impliciti (“area”, “argomento” e “target”); le espressioni “quantum mechanics”, “spin” e “10-years-old” sono i valori che assumono questi parametri. Tutta la frase è uno schema che si può svuotare e riempire con altre triple di valori (“letteratura italiana”, “donna dello schermo”, “calciatore”).

Da prompt è stato derivato “prompt engeneering”, cioè la capacità di scrivere buoni prompt, che fa sentire ingegneri anche solo a pronunciarla. Una capacità che si insegna ormai in innumerevoli libri e corsi, alcuni dei quali dedicati a insegnanti e a studenti. Ingegnerizzare significa organizzare le cose in maniera efficiente; in questo caso, “prompt engeneering” significa semplicemente conoscere degli schemi e saper mettere i valori giusti al posto giusto. Non sembra esattamente un arte e non ci vuole una vita per impararla; comunque, una volta messa da parte, non si capisce bene dove possa venire riusata.

[i]L’architetto e l’oracolo, Laterza, 2023